Anthropic的Claude:欧洲的数据、流量和战略问题

谁从这种氛围中受益?

Claude已成为软件开发辅助、复杂文本分析和长推理方面最高效的人工智能模型之一。这一主导地位建立在严格的技术选择、大规模资本获取以及与美国工业生态系统的紧密集成基础之上。

本分析的目标是从欧洲角度解构使用Claude的实际影响:数据去向、金融回路、法律和战略依赖关系,以及持续缺乏可比较水平的欧洲替代方案。

Anthropic的法律性质和经济重心

Anthropic是一家美国法律下的企业,在美国以公共利益公司地位注册成立。这种法律形式在治理中引入了公共利益使命,但并未改变企业的经济目标或其司法管辖权归属。

有关知识产权、模型架构、商业策略和财务轨迹的结构性决策都在美国做出。连续的融资轮次,金额巨大,主要来自美国投资者或美国技术生态系统的战略盟友,包括超大规模云服务商和大型机构基金。

在欧洲开设办事处,特别是在巴黎和慕尼黑,改善了当地的运营存在,但并未改变企业的实际控制中心。治理、资本和决策能力仍然集中在欧盟之外。

来自欧洲用户数据的处理和使用

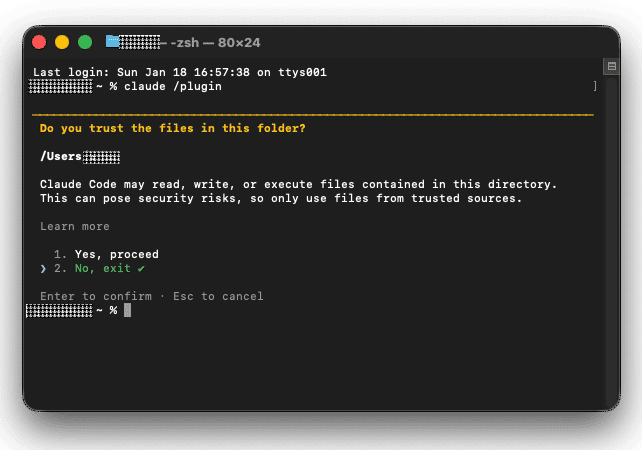

使用Claude涉及将文本数据或代码传输到由Anthropic及其云合作伙伴运营的基础设施。即使从欧盟内部访问服务,数据处理也不一定限于欧洲境内。

Anthropic声明遵守GDPR,并为专业客户提供适当的合同机制。然而,这种合规性既不保证数据在欧盟内的独家本地化,也不保证完全独立于欧洲以外的司法管辖区。

一个特别值得关注的点是为了改进模型而使用数据。默认情况下,某些交互可能会被纳入训练过程,除非用户明确反对。这种逻辑在法律上受到约束,但在操作上不对称,有利于非欧洲参与者获得信息优势。

因此,欧洲用户产生的数据参与了战略资产的丰富,而其价值和控制权在很大程度上脱离了欧洲。

金融流动和价值创造的循环

通过订阅和使用Claude API产生的收入由Anthropic收取。这些收入主要用于资助研究、计算基础设施、高技能人员成本和企业增长。

Claude在欧洲的采用所创造的经济价值间接惠及Anthropic的投资者和工业合作伙伴,这些参与者主要位于欧盟之外。即使使用的云基础设施物理上位于欧洲,价值链在技术和资本层面仍然由美国参与者主导。

这导致了结构性不对称:欧洲为战略参与者的盈利和崛起做出贡献,却不拥有控制权,也无法获得长期价值的重要份额。

欧洲监管和技术依赖

欧盟在数据保护和人工智能方面制定了雄心勃勃的监管框架。该框架旨在规范使用、限制风险并保护基本权利。 然而,监管能力无法弥补工业控制的缺失。欧洲发现自己处于这样一种位置:它监管着自己无法在必要规模上生产的技术,同时依赖这些技术来维持其企业的竞争力。 这种情况在规范主权和运营依赖之间造成了持久的紧张关系。 它限制了欧盟面对拥有更强财政和技术实力的参与者时的战略操作空间。

欧洲替代方案的现状

欧洲存在旨在开发语言模型、主权基础设施和符合当地监管要求解决方案的倡议。这些项目在治理、透明度和合规性方面具有一定的意义。

然而,在这个阶段,没有欧洲解决方案能够在性能、工业成熟度和大规模采用方面与Claude完全竞争,特别是在高级软件开发等复杂用途方面。

这种情况不是由于能力不足,而是由于投资、计算能力和工业协调方面的差距。

欧盟的战略挑战

在欧洲专业环境中大规模使用美国AI解决方案加强了结构性技术依赖。这种依赖使欧洲面临法律、经济和地缘政治风险,特别是在监管分歧或国际紧张局势的情况下。

从长远来看,缺乏可信的欧洲替代方案限制了欧盟根据自己的经济和社会优先事项定义自己的技术标准和指导AI发展的能力。

氛围结语

Claude目前是开发和分析智能辅助方面的参考工具。欧洲参与者采用它是可以理解的,因为它带来了生产力的提升。 然而,这种采用发生在这样一个框架内:数据、金融流动和产生的战略价值主要惠及欧洲以外的生态系统。只要欧洲在尖端人工智能方面不具备可比较的工业能力,这种不对称就会持续存在。

挑战不是放弃使用这些技术,而是清醒地认识到它们所造成的依赖关系,并在大陆范围内进行必要的投资以减少这些依赖关系。